第98回

〈後編〉小林啓倫さんロングインタビュー

生成AIはいずれ創造性を獲得する。そのときクリエイターに価値はある?

2023年12月17日 15時00分更新

ユーザーだって間違えるし、倫理的に常に正しいわけでもない

―― 医療AIのように、命を守るために分析過程の説明可能性よりも精度を優先しているのだ、ということが患者(顧客)に「説明」できるレベルにまで議論を重ね、組織としての対応方針を定めることが重要なわけですね。

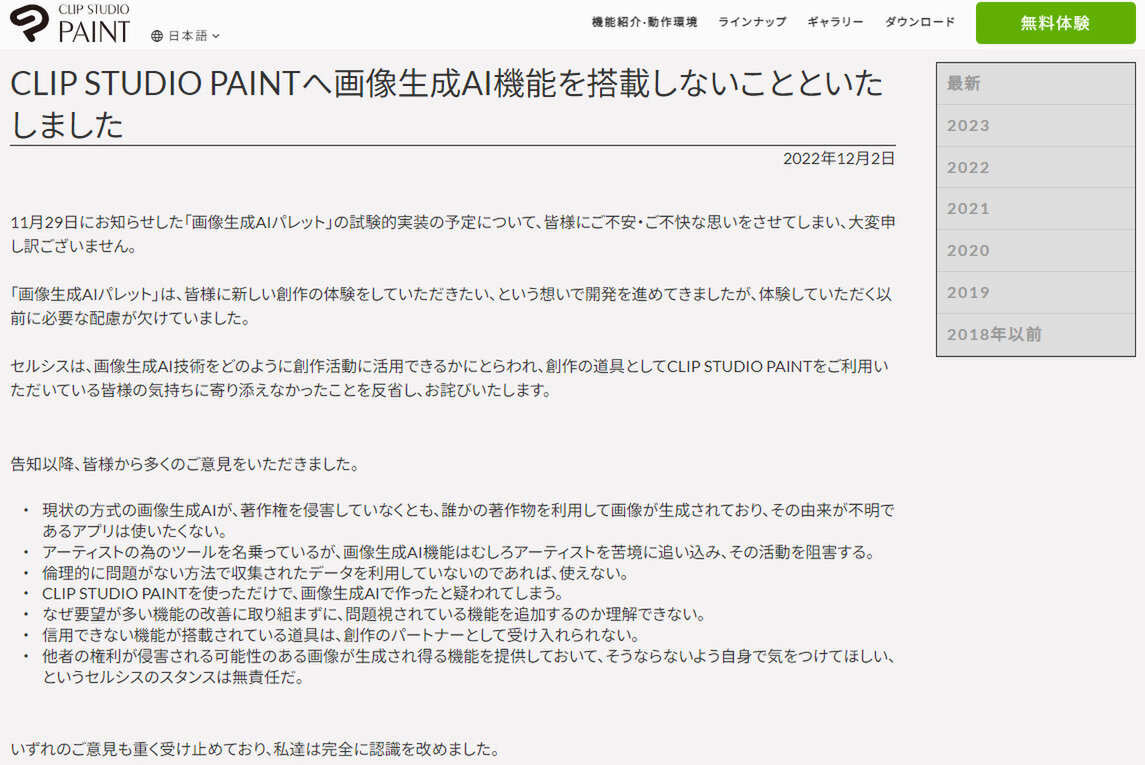

たとえばCLIP STUDIO PAINTのイラスト生成AIならば「優先事項は生産性」という方針が定まっていれば、ユーザーの批判も受け止めたうえで機能を実装出来ていたかもしれないのでしょうか? 「皆様に新しい創作の体験をしていただきたい」という想いだけでは倫理のストラクチャーとしては弱かったと。

小林 そうですね。本書のなかで「つまり顧客の意見を聞けば良いの?」という問いかけがあったのを思い出しますね。でも、顧客だって間違えることはあるし、倫理的に常に正しいわけでもありません。

もう少し原理・原則に立ち返って「説明可能性を実現するというのはどういうことなのか」を確認する必要があります。もちろん顧客の意見には耳を傾けつつ、自分たちが実現したいこととのバランスを踏まえて、「私たちはこうします」という方針を打ち出していく。

たとえば「要望が多い機能の改善に取り組まず、問題視されている機能を追加するのか」という意見が紹介されていますが、企業は必ずしも顧客の要望にすべて応える必要はありません。むしろ、新しい事業にチャレンジしていくことが重要です。これはアップルなどを念頭に置けばイメージしやすいと思います。

AIは既存の倫理に影響を与える存在です。それを十分に認識せずに、新しいから・話題になっているから、という理由で導入してしまうとユーザーの反発を招き、それに対する企業としてのメッセージも用意されていないために、本当はユーザーにも利益があったものかもしれないのにキャンセルせざるを得なくなってしまう。

導入発表前に、本書にあるようなチェックポイントを確認したうえで臨んでいれば、ユーザーからの意見に説明したり、場合によっては反論するなどの対応ができていたはずなのです。

―― ある意味、倫理基準を示すことで「どこまでが自分たちの顧客か」という線引きをすることにもなるわけですね。SNSなどを通じて際限なくつながる時代ではありますが、全員を満足させることもできないわけで。

しかし、AIが提供できる価値は「未来はこうなる」という予測ベースのものとなります。将来ビジョンを示しながら顧客とポジティブなコミュニケーションを取ることを日本企業は苦手としそうです。

小林 たしかにそうですね。こういう本を出しておいてあれですが(笑)、AIにおける倫理をブレイクダウンしていく過程は、社内外で価値観を衝突させながら議論を煮詰めていくような作業で、「和を以て貴しとなす」文化が根強い日本ではハードルは高いです。よく言われる多民族=多様な価値観の衝突からの合意形成を前提とする北米には後れを取ってしまうわけです。

ここで挙げたようなチェックポイントを踏まえたうえでの、日本ならではのやり方、チューニングもいずれ生まれてくるのではと思います。

1つの例として、倫理委員会が下した決定に対して、強制力を持たせるか否かや、AI倫理を巡る懸案が生じたときに倫理委員会に持ち込まれるのかを必須とするか否かなどさまざまなパラメーターがあります。これらの組み合わせ方によって結果も異なってきます。

両方を強制するのが最も強力になるのですが、それを嫌って懸案事項を委員会に上げなくなる、というリスクが大きくなります。落としどころとして、委員会の決定は社長によって覆すことができるようするなど、駆け込み寺を用意しておくといった手法もありますよね。

アメリカ型のガバナンスをガチガチに効かせる方法だけでなく、日本型の根回し文化も取り入れることはできるはずです。

―― 本書の著者は、大学教員を経て企業家になったということで、異なる組織文化でのAI倫理のような未知のものを巡る意思決定について、バランスが取れた多様な見方ができている、とも言えそうです。

私たちユーザーはAIとどうつきあっていけば良い?

―― 効率的なサービスの提供などAIによる恩恵が比較的イメージしやすい企業側と、著作物が勝手に学習されてしまうといった懸念や不利益が大きくなるユーザー側とのギャップも大きくなっていると感じます。ユーザーはAIとどうつきあっていくべきなのでしょうか?

小林 残念ながら本書は実務書としてAIを利用する企業側の取り組みについて述べられているので、ユーザー側についてのお話は出てこないのです。

ただ、「いずれAIに学習させるデータが枯渇する」という指摘もあるなか、競争に躍起になっている企業側の倫理に期待しているだけではまずいことになるはずです。ましてや「学習禁止」を唱えるだけでは実効性がない。イーロン・マスク氏のような人物も出てくるくらいですからね(笑)

Grok 🥰 pic.twitter.com/bF1j6yUcga

— Elon Musk (@elonmusk) December 5, 2023

小林 まず、オンラインに公開したコンテンツはAIによる学習も含めて、どこかで使われるものだという前提に立つべきでしょう。そのうえで、どう行動すれば良いかといえば、先ほどのCLIP STUDIO PAINTの例のように、巧拙はあっても「ユーザーと向き合う」ことを志向する企業のプラットフォームを積極的に使うべきです。

そのためには規約などでユーザーが投稿したデータをどのように扱うのか(学習や模倣が起こった場合にどのように対処してくれるのか)を確認していく必要があります。

プラットフォームの側もユーザーからその観点によって取捨選択されるのだ、という緊張感のなかで事業運営されれば、安易な方向には向かいにくくなるでしょう。逆に言えば、ユーザーが声をあげていく必要があるでしょう。

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります