SDXL対応のモデルやLoRA、ControlNetが簡単に

SDXLはリリースから半年ほどが経ち、歩みがゆっくりではありましたが、それでもいろいろと環境が整いつつあります。

たとえば、2024年1月にユーザー主導で開発されたアニメ特化型モデル「Animagine XL 3.0」。非常に鮮やかでアニメっぽい絵柄が簡単に出るため「革命的だ」と話題になりました。Stable Diffusion 1.5ベースのモデルにここまで色鮮やかな色彩は出せません。SDXL対応LoRAも様々なものが開発され、SDXL用のControlNetも品質の高いものが出てきました。こうしたSDXL向けの諸々が、Forgeによって手軽に試せるようになったわけです。

WebUI A1111の資産を引き継げる

機能としてありがたいのはStable Video Diffusionに対応していること。Stablity AIのサイトからモデルをダウンロードして設定すれば、何も気にせず簡単に生成ができます。

lllyasviel氏のStable-Diffusion-WebUI-ForgeにSVDというタグがあったので、Stable Video Diffusionだよなあと思って、SVD1.1を落としてきて、Modelに配置して生成してみた。ものすごく簡単に、SVDで動画を生成できた。 pic.twitter.com/L5B4scZUuZ

— 新清士@(生成AI)インディゲーム開発者 (@kiyoshi_shin) February 6, 2024

また、これまでのA1111ユーザーにとっては、ControlNetやLoRAなどの資産がそのまま使えて、環境として引き継げるという利点もあります。

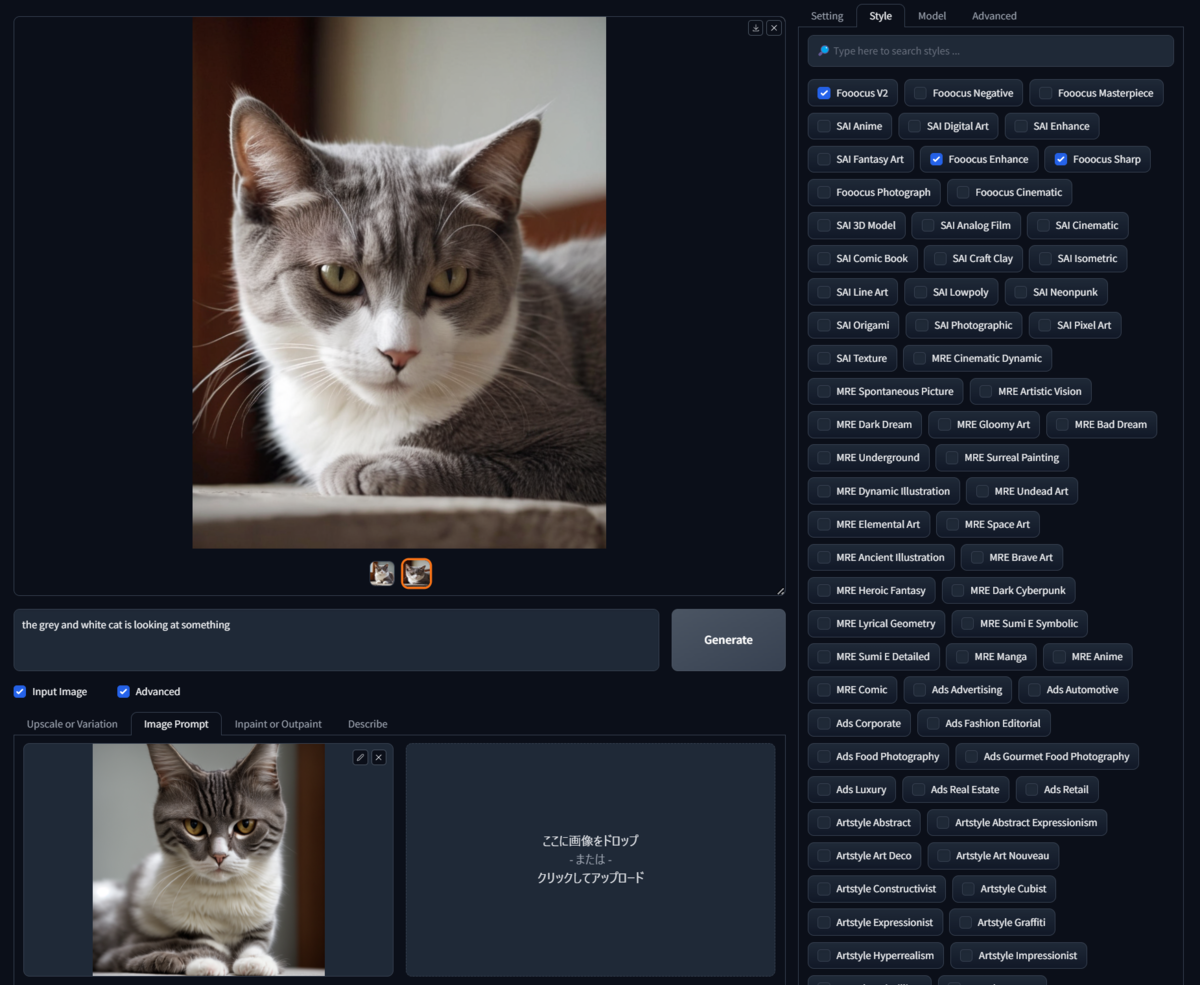

これまで、SDXLに特化したユーザーインターフェースとしてはIllyasvielさんが開発したFooocusがあり、こちらも様々な機能強化が勧められてきました。あらかじめ画風ごとに用意されたプロンプト「Style(スタイル)」や、ControlNetの一種で画風をコントロールする「ImagePrompt(イメージプロンプト)」といった独自機能が追加され、簡単に扱えるようになっています。ただ、その特性上、細かい処理を施そうとしても、思ったものとは違うものが出てきてしまうところがありました。A1111ベースのForgeではその心配がありません。

一方、Forgeの弱点としては、処理方法がA1111と変わっているために、「日本発の画像生成AIサービスがすごい」で紹介したアップスケール機能の「Tiled Diffusion」が使えないんですね。これはセットで使う「Tiled VAE」が最初からシステムに統合されているためのようで、「Tiled Diffusion」に慣れていたユーザーはアップスケールの方法を模索する必要がありそうです。

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります