すでに回答者の10人に1人が音声詐欺に遭っている

近い将来、あなたの「声」のクローンが詐欺に悪用されるかもしれません。

家庭用セキュリティ対策製品を手掛けるマカフィーは、AI(人工知能)を悪用したオンライン音声詐欺の現状に関するレポート「The Artificial Imposter」を発表しました。これは世界(日本、米国、英国、ドイツ、フランス、インド、オーストラリア)を対象に実施した調査をまとめたもの。

おすすめの関連記事

偽AppleからのSMSに騙されるとApple ID乗っ取られるかも!?

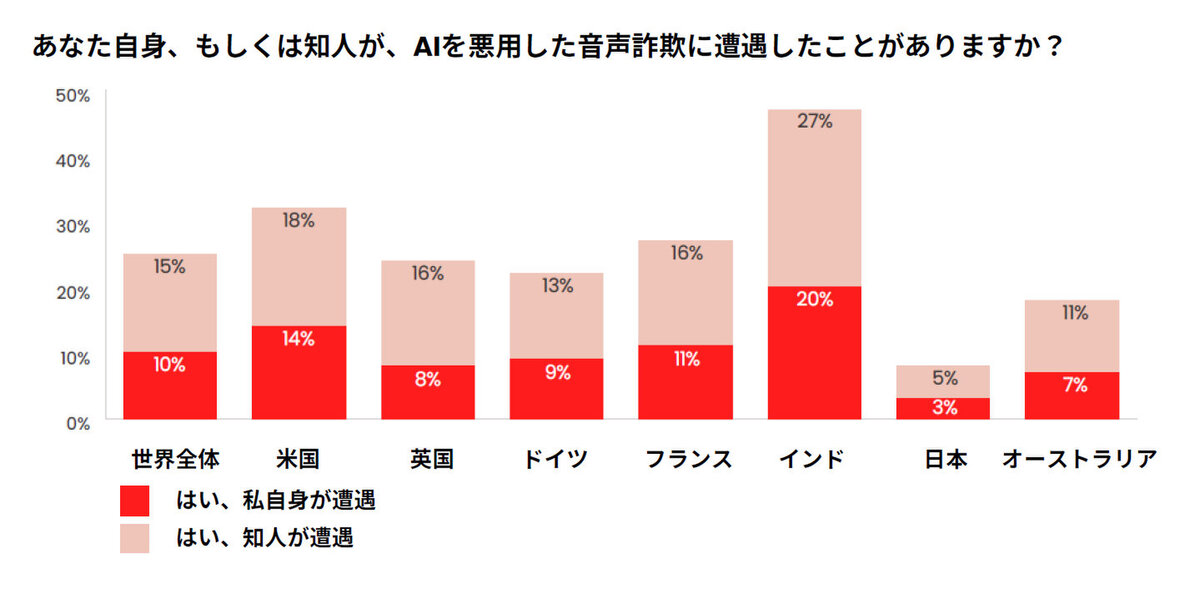

レポートによると、回答者の10%がすでにAI音声詐欺に遭遇、知人が遭遇したと回答した人も15%に達しています。また、被害者の77%が金銭被害を伴っているとのこと。遭遇率が最も高かった国はインドで、本人が20%、知人に至っては27%に達しました。

一方、日本は世界7ヵ国のなかで遭遇率が最も低く、遭遇した人は3%、知人が遭遇した人も5%と、世界平均のおよそ3分の1でした。

「AI×音声」と聞くと、『ついに“ほんやくコンニャク”が実現か!?』『声優の仕事が奪われるかも……』といったあたりが連想されがちですが、実際は詐欺への悪用が一足先に「実用化」したかたちです。

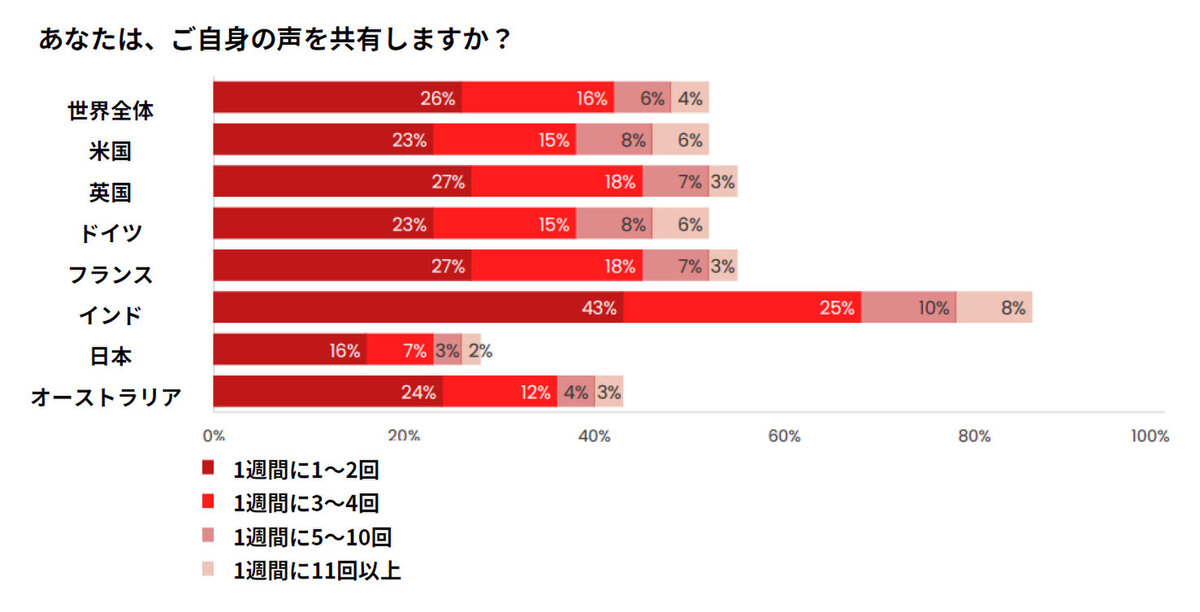

マカフィーによれば、「人の声(声紋)は、生体認証として個人を特定できるユニークさを有し、声を通じて信頼関係が確立されている」ことが多いものの、調査対象である成人の過半数が「週に1回以上(SNSやボイスメモなどを通じて)自身の音声データをオンラインで共有しており、この声がコピー・悪用され、サイバー犯罪者の格好の材料に」なっているとのこと。

そして悪意ある人たちは、急速に発達しているAI技術を使い、目標に近しい人の「声のクローン」を作ることで、「困窮を偽ったボイスメールを送ったり、被害者の連絡先に電話をかけている」と言います。

また、「回答者の70%(『識別できるかどうかわからない(35%)』と『識別できないと思う(35%)』の計)がクローン音声と本物の声の識別に自信がないと回答」していることから、声を使った詐欺は有効性が高いと見られています。

今回、日本の遭遇率は7ヵ国中最低でしたが、それは今後本格的に音声詐欺が上陸してくる、ということでもあります。しかも他国での被害をもとに、より洗練された手法が活用されることでしょう。

そして音声詐欺には「攻撃をボーダレス化」させる恐れがあります。今までは日本人が日本人に詐欺を仕掛けることが多く、海外からの詐欺は文言の日本語訳が怪しいため容易に判別が付きました。

しかし今後はAI技術によって、日本語ネイティブではない海外在住の悪意ある人たちが、あなたの親しい人たちそっくりの声でオレオレ詐欺を実行してくるかもしれません。

にわかには信じられないかもしれませんが、誰かがあなたの(偽の)声に騙されて金銭被害を被ることに心配しなければならない時代が来ているのです。

マカフィー株式会社 日本・アジア地域チャネルマーケティング本部長 青木大知氏のコメント

AIは私たちのビジネスで素晴らしい機会をもたらしたり、生活を便利にしたりしますが、悪用されるリスクもはらんでいます。

日本は他国に比べ、音声データのオンライン共有率が低く、結果的にAIを悪用した音声詐欺の遭遇率も低い傾向にありますが、この現状はむしろ、今後、音声詐欺に遭遇する可能性が高いとも受け取ることができます。

McAfee Labsの調査で、AIボイスクローニングツールを利用して、わずか3秒で85%※の一致率を有する音声クローンを作成できることがわかりました。

このようなAIを悪用した音声クローニング詐欺が横行しやすい現状を認識し、自分のアイデンティティーの共有に慎重になるとともに、音声詐欺の遭遇に備えた準備が必要です。

※音声照合精度は、McAfeeのセキュリティ研究者によるベンチマークと評価に基づいています。

週刊アスキーの最新情報を購読しよう