第971回

GTC 2026激震! 突如現れたGroq 3と消えたRubin CPX。NVIDIAの推論戦略を激変させたTSMCの逼迫とメモリー高騰

2026年04月13日 12時00分更新

GPUはもう計算だけではない

NVIDIAがLPUの力を借りて挑む、LLM推論の限界突破

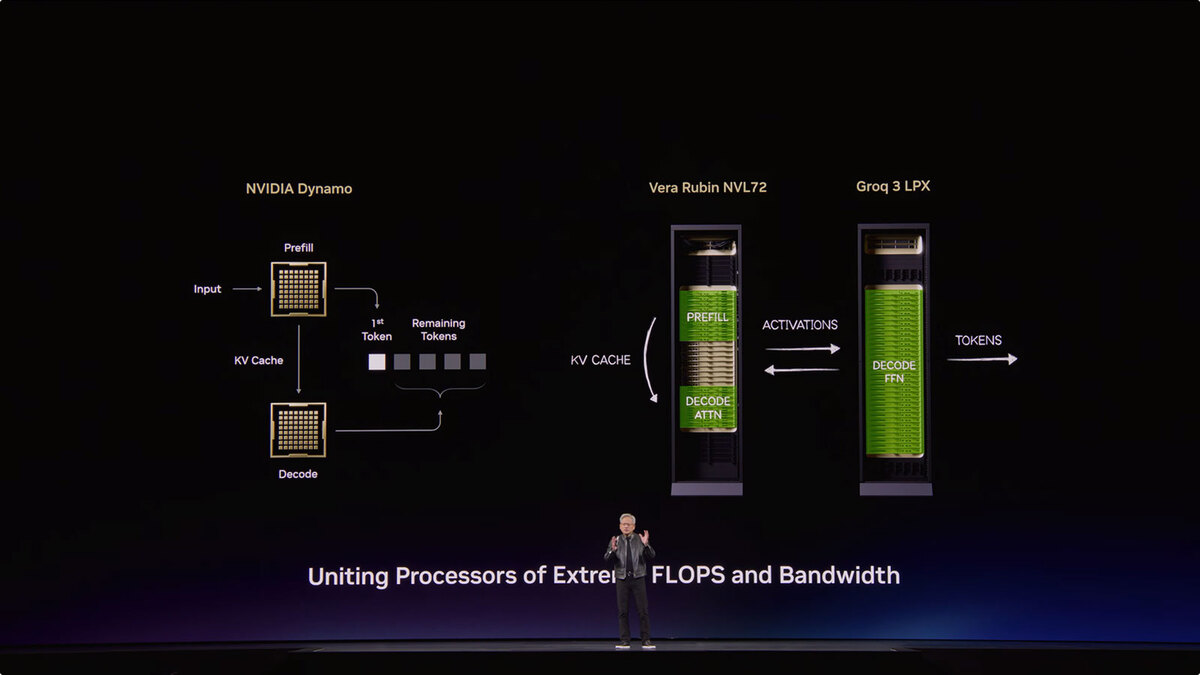

先にNVIDIAの発表を説明しておきたい。LLMの推論に関し、NVIDIAは2025年からDynamoと呼ばれるフレームワークをオープンソースで公開している。もともとLLMの推論ではPrefillと呼ばれる、入力されたプロンプト全体を処理し、最初のトークンとKV-Cacheを生成するフェーズと、Decodeと呼ばれる、直前のトークンを基にKV-Cacheを再利用して次のトークンを1つずつ生成するフェーズの2段階の処理に分割される。

下の画像はこれを模式図的に示したものであるが、当初はこのPrefillとDecodeを1つのシステム内で実行していた。

KV-Cacheは、KeyとValueの組み合わせである。LLMで採用されているTransformerというモデルでは、Query(Q)とKey、Valueという3つの行列を利用して入力された単語内の関連性を計算する仕組みになっている。Queryに対してどのValueを返すのが適切かを計算するのがAttentionと呼ばれるものである。

| KV-Cacheの役割 | ||||||

|---|---|---|---|---|---|---|

| Query | 現在の単語が「何を探しているか」を示す | |||||

| Key | 検索対象のラベルで、単語が「どんな情報を持っているか」を保持する | |||||

| Value | 実際の情報の値。要するに情報の「具体的な内容」を保持する | |||||

LLMでは入力された単語を随時処理していく。だから最初のトークンはPrefillで生成される形だが、2つめの単語が入力されるともう一度トークンのAttentionの計算がされ直される。以後、単語が入るごとにAttentionの計算がやり直されるため、計算量が爆発的に増える。

これを少しでも軽減するために、Prefillの段階でKeyとValueをセットにしたKV-Cacheを構築しておき、Attentionの再計算はこのKV-Cacheを利用することで計算負荷を減らそうというものだ。このAttentionの再計算を行うのがDecodeである。

DecodeにはこのAttentionに加えてもう1つ、FFN(Feed Forward Network)という処理が入る。Attentionはトークン同士の関係性、いわば文脈情報が出力される形だが、FFNはこれを最終的に出力される文章に変換する役割を果たすと言えるだろう。この変換に際しては、猛烈にメモリー帯域が必要になる。これは猛烈な量でKV-Cacheを参照するためだ。この結果、Prefillでは計算能力が重要になる一方、Decodeではメモリー帯域が重要になる。

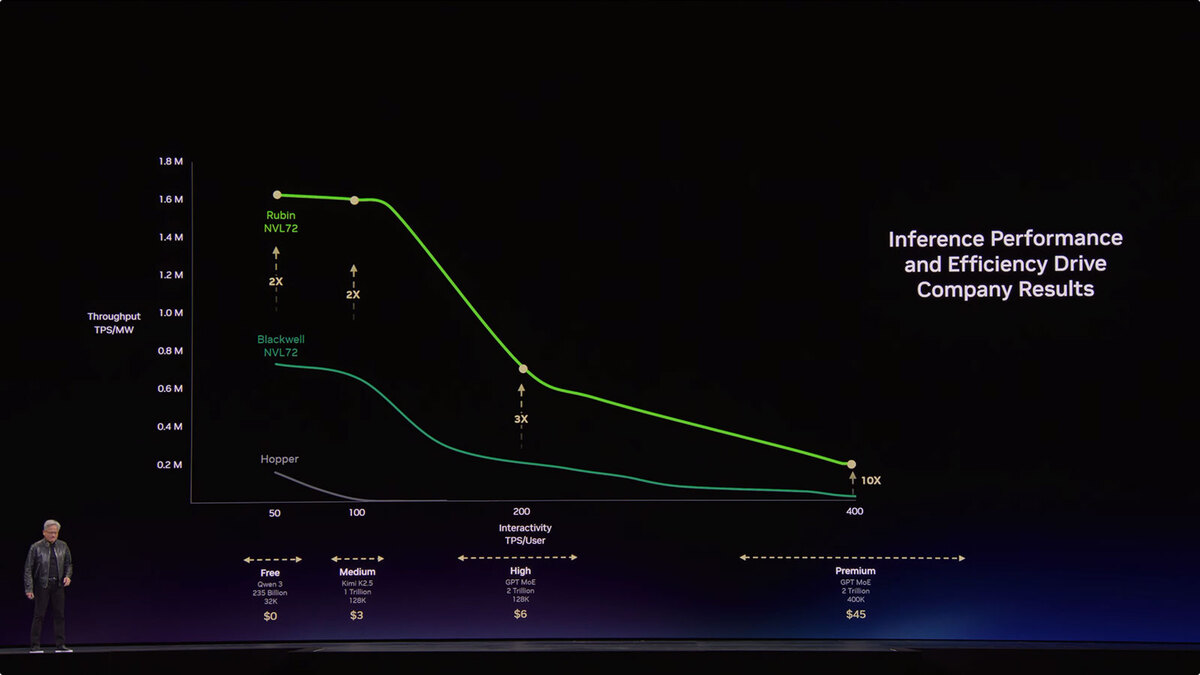

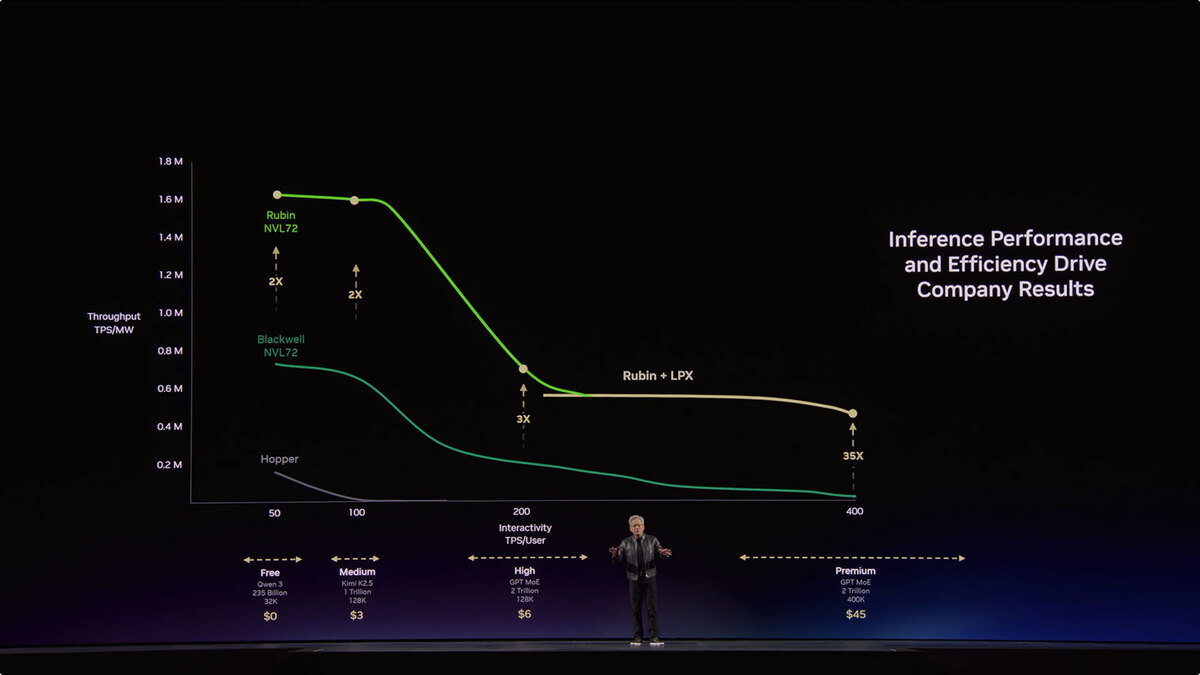

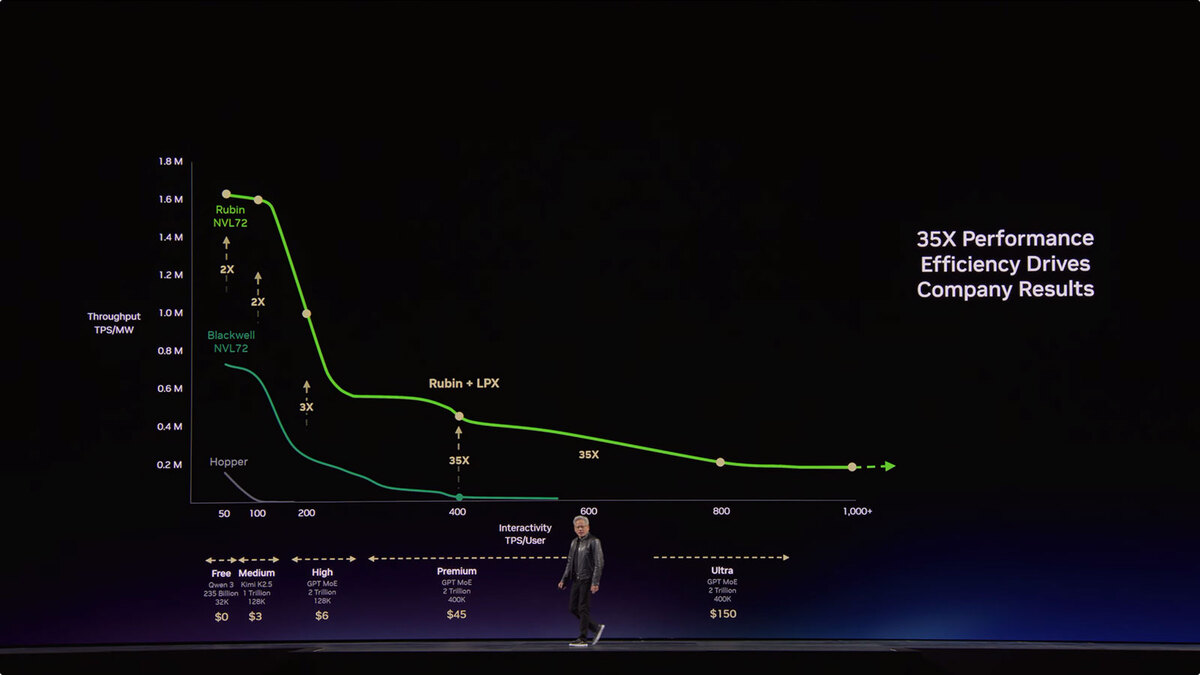

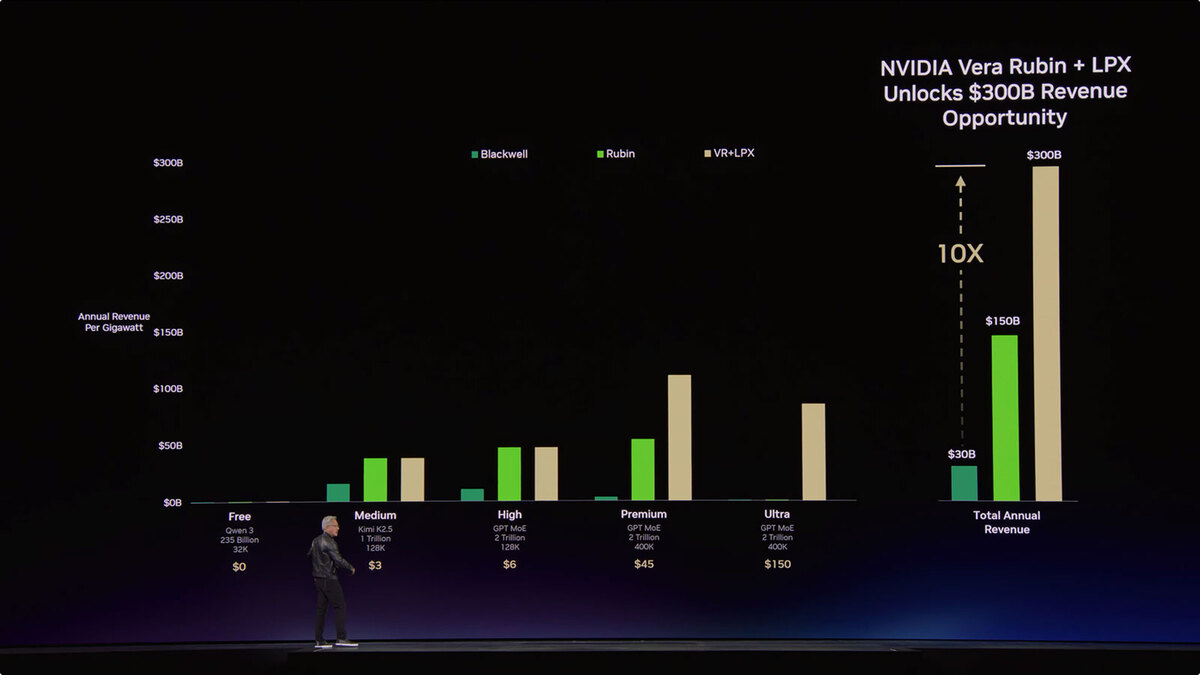

そこでNVIDIAはRubinにGroqのLPUを組み合わせることを決めた。実際Rubin単体でのLLMのスループットは、Blackwell比で2~10倍程度だが、ここにGroq 3 LPXを組み合わせることで、ユーザーあたり400 トークン/秒における性能をNVL72の35倍近くまで引き上げられる、としている。

さらに言えば、これまで処理性能が恐ろしく落ちていた1000トークン/秒の領域でも結構なスループットを維持できるとしている。これはAI推論のサービスを提供しているベンダーにとって、売り上げを10倍に伸ばせるチャンスだ、としている。

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります