今回は少し毛色を変えて将来のチップレットについての話だ。IEDM 2025のショートコースで発表されたAMD FellowのNuwan Jayasena博士による"Memory-Centric AI Architecture through Advanced Packaging and Heterogeneous Integration"の内容をご紹介したい。話としてはInstinct MI300Xが中心になるのだが、なぜInstinct MI300X?という話は最後に説明する。

SRAMかDRAMか? AIプロセッサーにおけるメモリー選択のジレンマ

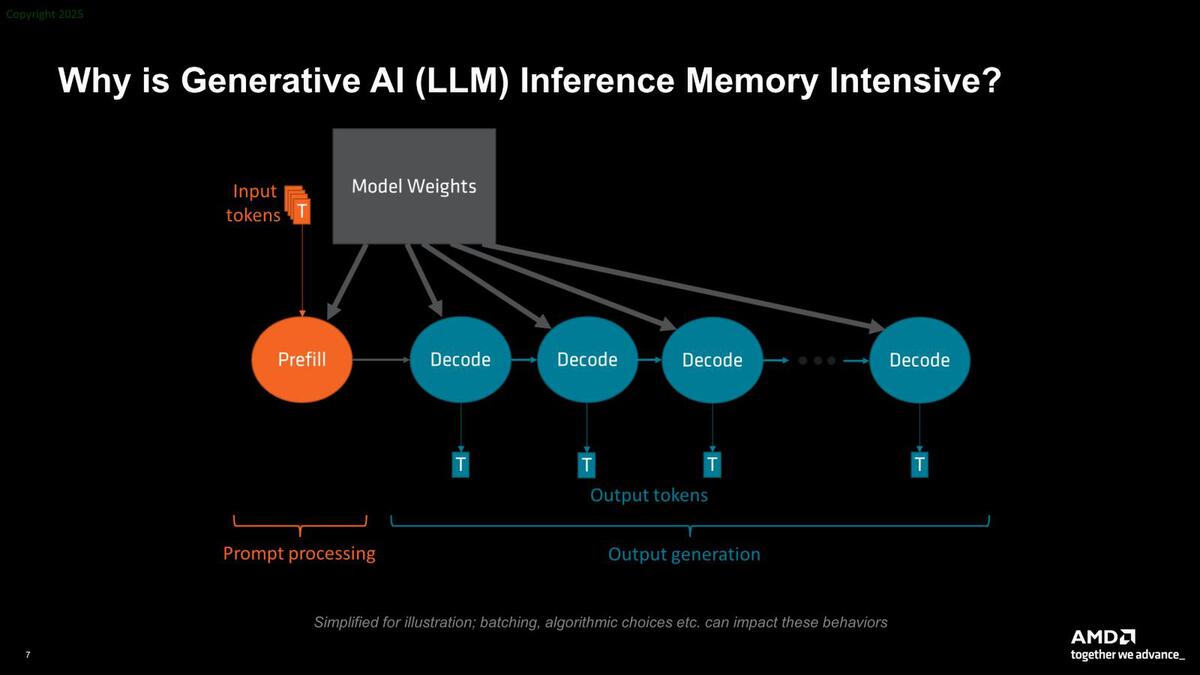

LLMにしても生成AIにしても、昨今のAI処理はとにかくメモリーの利用量が半端ないという話はご存知の通り。これはWeightの数がすさまじいからで、このWeightをどうやってローカルのRAMに押し込むかで性能が大きく変わることになる。

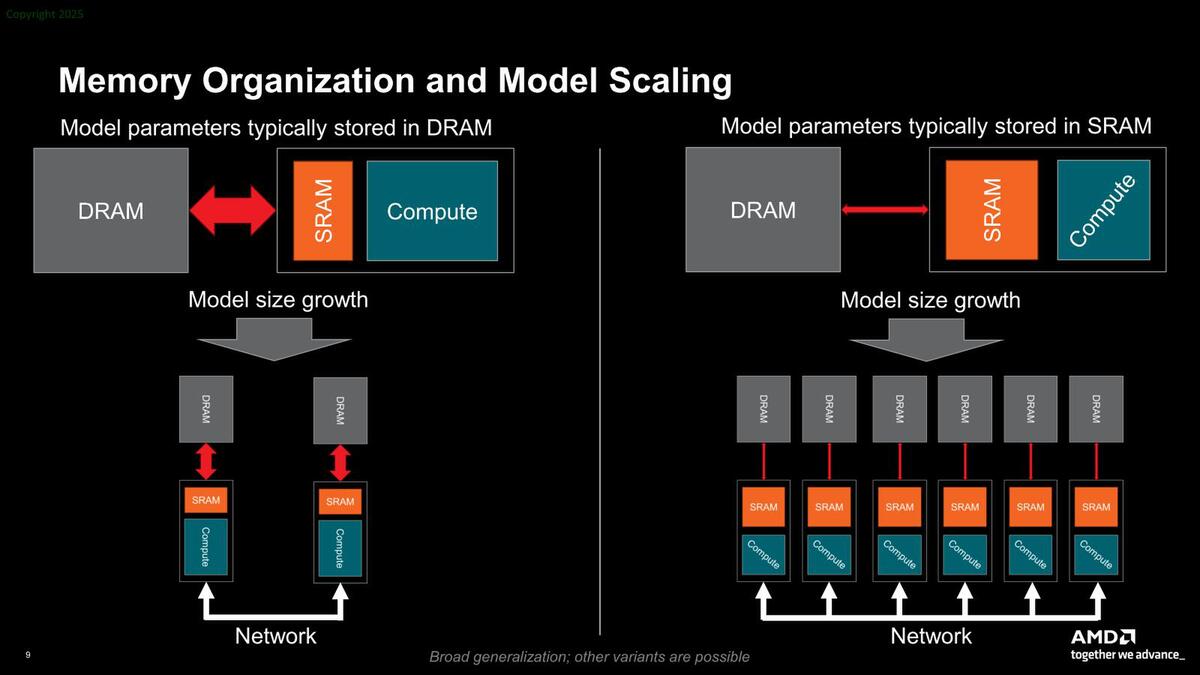

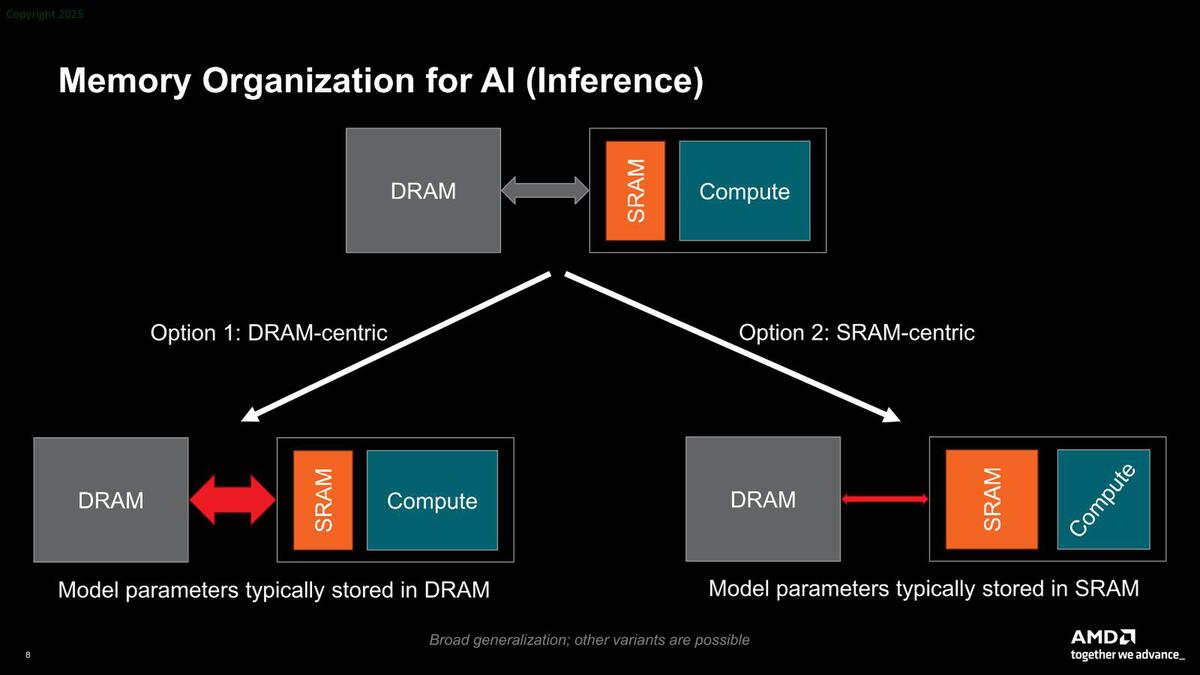

このRAMをSRAM主体にするか、DRAM主体にするかというのが次の問題。一般論としてAIプロセッサーはSRAM主体が多く、GPU系はDRAM主体となる。どちらが良いかは実装に関わってくる問題であるのだが、最近はLLMにおけるWeightの数の急増により、DRAM主体がやや優勢である。

DRAM混載プロセスは20nm世代が最後になっており、今は(積層するにしても)別チップの形になる。それもあってAIアクセラレーターの中にはSRAM主体で実装、というものが少なくない。こうしたケースでは当然WeightはSRAMに格納される

といってもスケーリングさせないとどちらも1つのプロセッサーだけでは処理できないので、結局スケールアップないしスケールアウト(これも議論がいろいろあるがここではおいておく)の形で複数のプロセッサーをつないで処理を分担する格好になる。

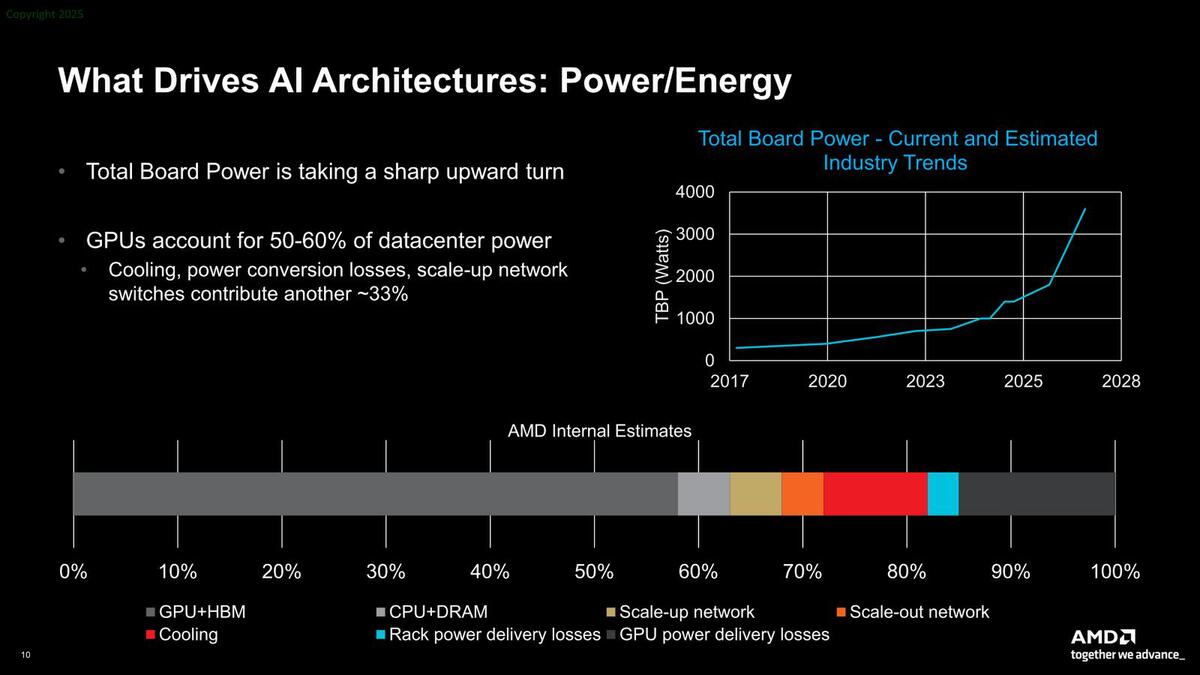

ちなみにプロセッサーの消費電力の内訳が下の画像である。AMDなので当然モデルはInstinct MIシリーズのものと思うが、全体の半分強がGPU+HBMで、残りはその他ということになる。

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります