第45回

面白すぎて危険すぎ! PCを“勝手に動かす”AI、OpenClaw(旧Moltbot/Clawdbot)とは

2026年02月02日 17時00分更新

Claude Codeと何が違うのか

OpenClawについては、「それならClaude Codeなどの開発支援AIでも同じことができるのではないか」という疑問が浮かぶ。実際、ファイル操作やコード修正、コマンド実行といった作業の多くは、Claude Codeでも自律的に最後まで任せることができる。

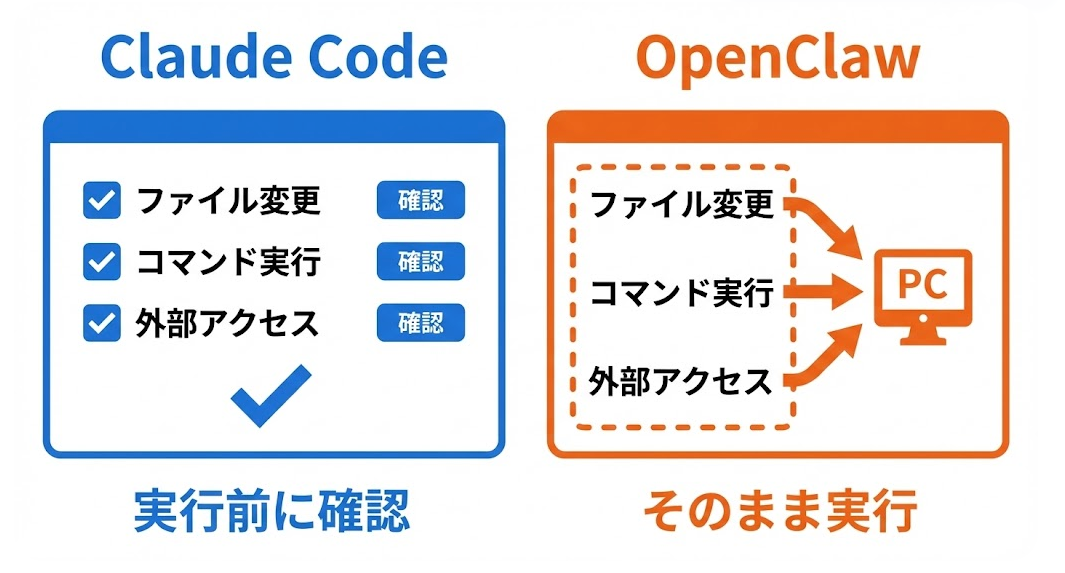

違いは、自律実行できるかどうかではなく、どの程度のガードレールが残るかにある。Claude Codeでは、自律的に作業を進めさせることが可能でも、実行範囲はIDEやプロジェクト単位に限定されており、操作の内容や影響範囲が構造的に絞られている。設定次第で操作ごとの確認を求めることもでき、常に人間が介入して止められる余地が残る設計だ。

一方OpenClawは、エージェント自身が判断し、そのままPC操作を実行することを前提にしている。ファイルやネットワーク、認証情報まで含めて操作対象になり得るため、ガードレールは用意されているものの、どこまで効かせるかはユーザーの運用と理解に委ねられる。この設計が、利便性の高さと同時に危険性が指摘される理由でもある。

つまり両者は、「自律的に動かせるか」という点では共通しているが、「最低限の安全装置が常に残る設計か」「その外し方までユーザーに委ねる設計か」という点で性格が異なる。OpenClawは既存ツールの単純な代替というより、生成AIをどこまで自由に、実行主体として扱えるのかを試す実験的な存在と捉えるほうが近い。

非公式ツールが突きつける「現実的な代償」

OpenClawの利用には、技術的なリスクとは別に、現実的な代償も伴う。非公式ツールである以上、LLM提供元の利用規約に触れる可能性があり、長期にわたって安定して使い続けられる保証はない。

また、公式APIを介さない接続や想定外の使われ方は、プラットフォーム側から検知され、制限の対象となる場合がある。動いている間は便利でも、仕様変更ひとつで突然使えなくなる不安定さがつきまとう。個人主導で始まったプロジェクトであり、開発が継続されるかどうか、問題への対応がどれだけ早いかといった点にも不確実性が残る。

今は「少し待つ」が現実的

OpenClawは、生成AIが「答える存在」から「実際に動く存在」へと変わりつつある流れをわかりやすい形で示している。PC操作をそのまま任せられる体験は新鮮で、これまでの生成AIとは明らかに感触が違う。

ただし、この分野の動きはとにかく速い。1日どころか、数時間単位で状況が変わることも珍しくない。OpenClaw自体も名称変更や仕様の更新、周囲の評価が短期間で入れ替わっており、この記事の内容も明日には一部が変わっている可能性がある。

そう考えると、OpenClawを普段使いのPCや仕事用アカウントにそのままつなぐのは、現時点では慎重でいたほうがいいだろう。隔離したVPSやDocker環境(普段のPCや個人データと切り離した環境)を使い、失っても困らないアカウントで試す、という距離感が現実的だ。

確かに魅力は大きいが、仕組みやリスクを十分に理解できていない人は、少し様子を見ることを強く勧めたい。OpenClawは日常の道具というより、「AIがPCを動かす時代」がどんなものかを先に体験するための存在として捉えるのが、今のところちょうどいいだろう。

1969年生まれ。ウェブサイト制作会社から2003年に独立。雑誌、書籍、ウェブサイト等を中心に、ソーシャルメディア、クラウドサービス、スマートフォンなどのコンシューマー向け記事や、企業向けアプリケーションの導入事例といったエンタープライズ系記事など、IT全般を対象に幅広く執筆。2019年にはタイのチェンマイに本格移住。

新刊:発売中「生成AI推し技大全 ChatGPT+主要AI 活用アイデア100選」、:https://amzn.to/3HlrZWa

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります