第45回

面白すぎて危険すぎ! PCを“勝手に動かす”AI、OpenClaw(旧Moltbot/Clawdbot)とは

2026年02月02日 17時00分更新

なぜここまで熱狂を呼んだのか

OpenClawが短期間で強い注目を集めた背景には、生成AIの使い方に対する不満と期待が積み重なっていたことがある。チャットUIのAIは便利だが、最終的な操作は人間が行う必要があり、「分かっているけれど面倒な作業」がどうしても残ってしまう。OpenClawは、その空白を埋めてくれる存在として受け止められたのだ。

技術者の反応が特に熱かったのも、その点にある。単なるデモにとどまらず、実際に日常作業を肩代わりできる水準に踏み込んでいたからだ。ファイル操作やコード修正、ブラウザ巡回といった異なる作業を一つの指示でまとめて扱える点が、「これこそが求めていたエージェントだ」という評価につながった。

数字を見ても勢いは明らかだ。公開からおよそ2か月でGitHubのスター数は10万件を突破し、極めて速いペースで支持を集めたプロジェクトとして報じられている。GitHubのスター数は、ユーザーがそのプロジェクトに関心や支持を示すために付けるもので、実質的には開発者コミュニティ内での注目度や評価の目安とされている。生成AIが実験や遊びの段階を越え、実用の域に入ったことを、具体的な体験として示した点が、この熱狂を後押ししているようだ。

最大の論点。なぜ「危険」だと言われるのか

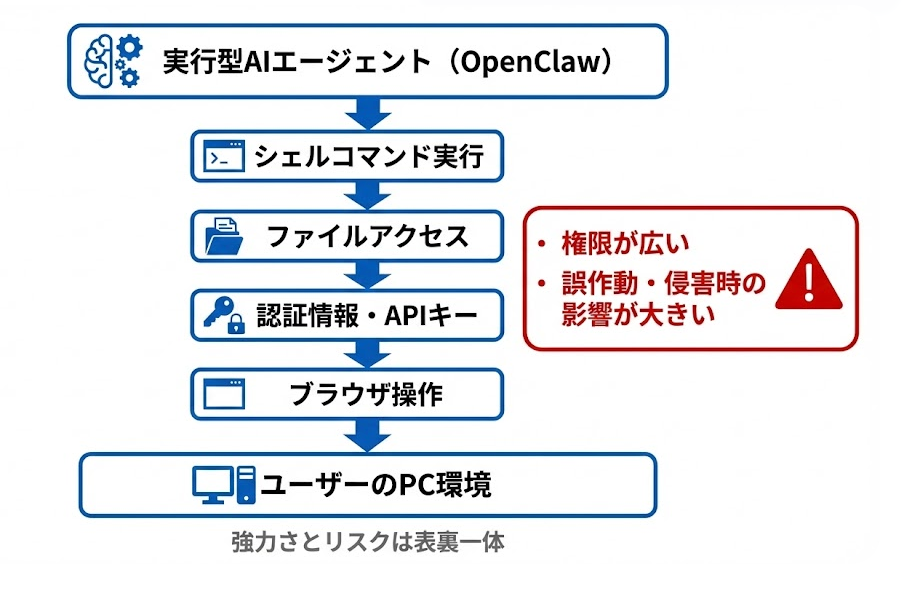

OpenClawに向けられる最大の批判は、その強力さと切り離せないリスクにある。設計上、OpenClawはローカル環境でシェルコマンド(PCを直接操作する命令)を実行できるため、非常に高い自由度を持つ。その一方で、扱える権限は極めて広く、侵害や誤作動が起きた場合には、PC内のファイルや保存された認証情報、APIキー(外部サービスを利用するための鍵)にまで一気にアクセスされる可能性がある。

とりわけ問題視されたのが、拡張機能(スキル)の扱いだ。2026年1月末には、研究目的で公開されたバックドア(不正侵入の抜け穴)を含むスキルが、コミュニティのランキング上位に表示されてしまう事例が報告された。見た目には便利そうな拡張を追加するだけで、PCの制御権を第三者に渡しかねない構造が、現実のリスクとして示された形だ。

さらに、管理画面や操作用ゲートウェイ(外部からの接続口)の露出も問題となった。初期設定やネットワーク構成を十分に理解しないまま運用した結果、管理画面がインターネット上に無防備な状態で公開されていた事例が確認されている。改名の混乱に乗じたSNSアカウントの乗っ取りや詐欺行為も報告され、リスクはもはや理論上の話にとどまらなくなっている。

誤解されがちな点。「対策」と「運用の壁」

とはいえ、OpenClawが無防備な危険物というわけではない。Dockerなどを使ったサンドボックス化(隔離された環境での実行)や、実行可能なコマンドを制限するAllowlist(許可リスト)、操作内容を記録する監査ログの取得など、リスクを抑えるための手段は一通り用意されている。

問題は、それらが自動で有効になるわけではない点にある。適切に機能させるには、サーバー管理やネットワーク設定、権限設計といった基礎的な知識が欠かせない。利便性だけを期待して導入し、設定の意味を理解しないまま使えば、危険性は一気に表面化する。ツールそのものの善悪というより、運用に求められる前提知識のハードルが高いことが、ここでの本質的な問題だ。

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります