インストール方法、使い方も解説

SD3.0の汚名返上なるか?!画像生成AI「Stable Diffusion 3.5」を試してみた

2024年11月06日 13時00分更新

ComfyUIでSD3.5を動かしてみる

準備ができたらいよいよComfyUIを起動しよう。まだComfyUIを使ったことがない人は当連載の「これは便利!「Stable Diffusion」が超簡単に始められる「Stability Matrix」」などの記事を参考にStability Matrix経由でインストールしておこう。

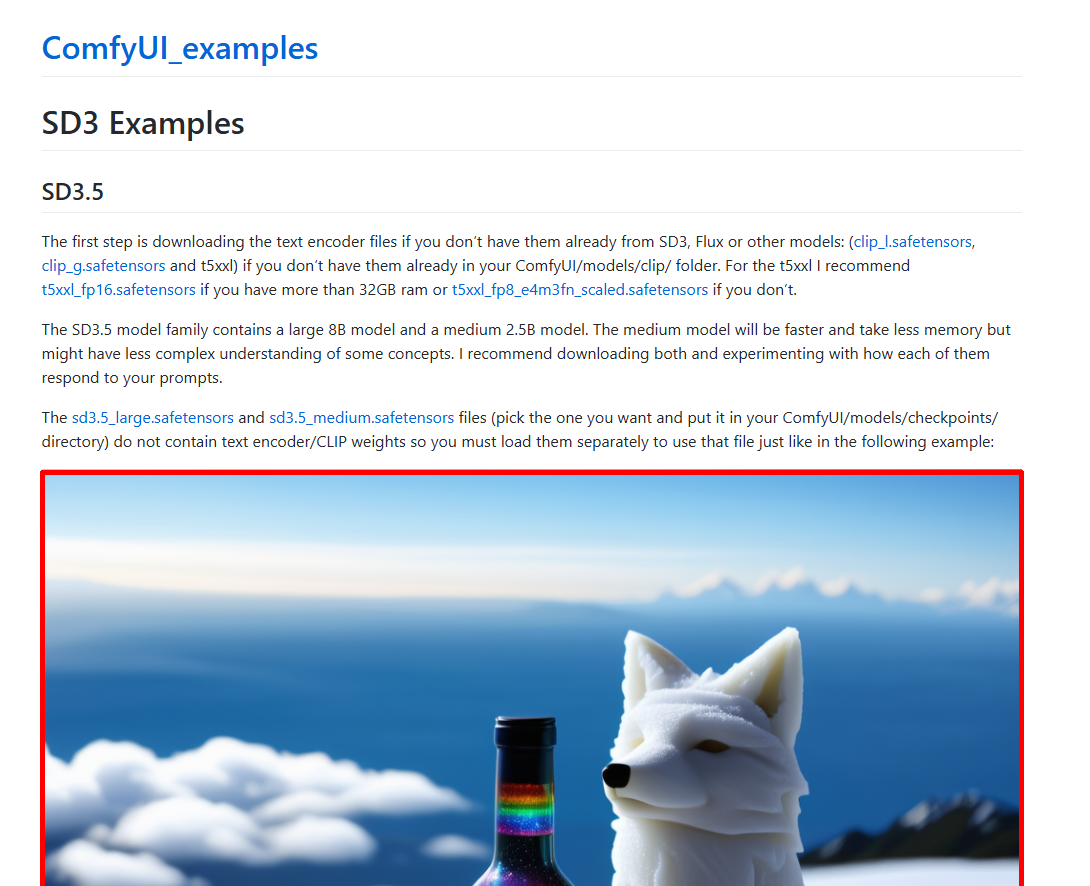

ComfyUIでSD3.5を使用するにはワークフローが必要だ。ComfyUI_examplesページにSD3.5用のサンプルワークフローが用意されているので今回はそれを利用することにする。

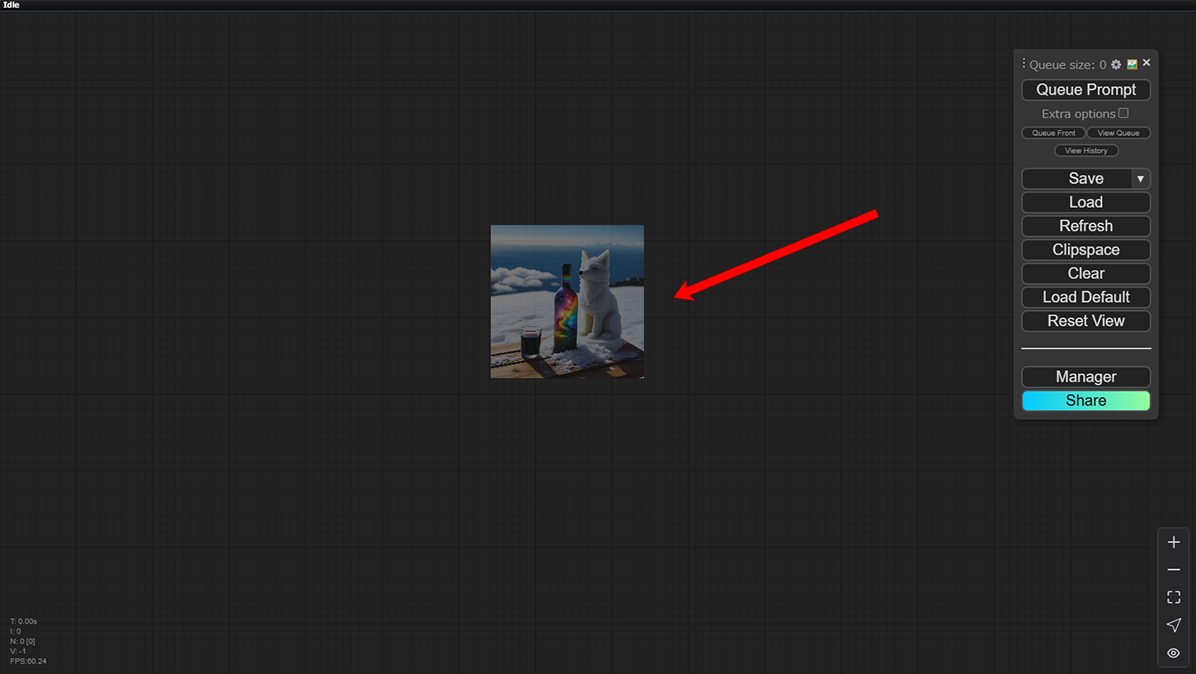

生成された画像をComfyUIの画面にドラッグ&ドロップ(画像をローカルに保存してからロードでも可)すればワークフローををインポートできる。

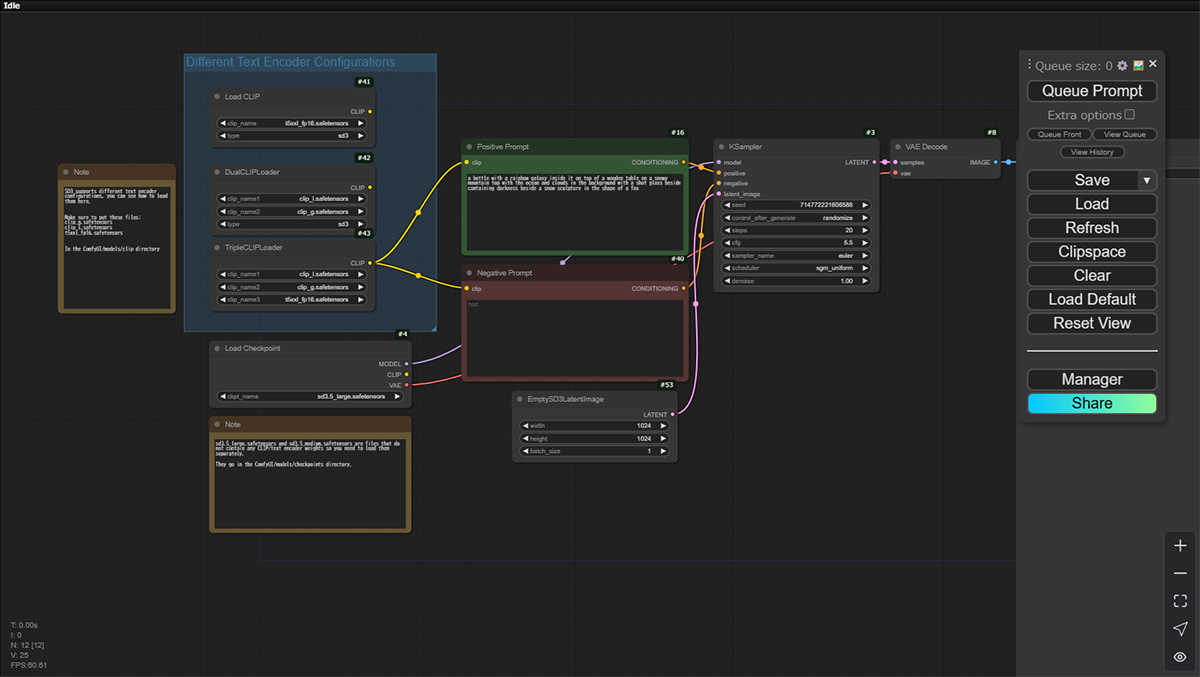

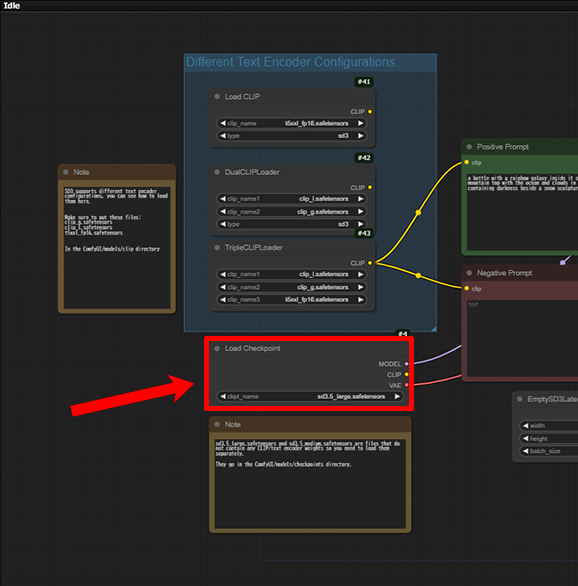

無事SD3.5用のワークフローが表示された。

まずは、左側下方にある「Load Checkpoint」ノード付近を「+」ボタンまたはスクロールホイールを使って拡大表示しよう。

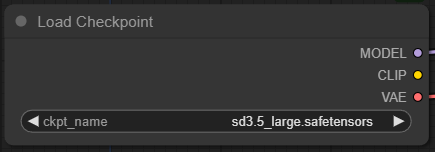

Load Checkpointは文字通りチェックポイント(AIモデル)を読み込むノードだ。デフォルトで「sd3.5_large.safetensors」が表示されているが、正しく選択されているか確認するために一度モデル名をクリック。

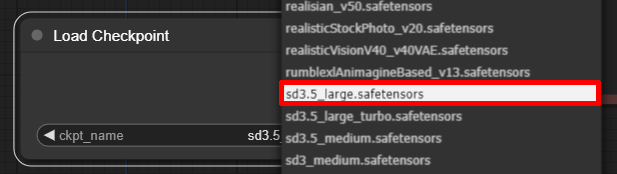

選択肢の中からあらためて「sd3.5_large.safetensors」を選択しておけば間違いない。

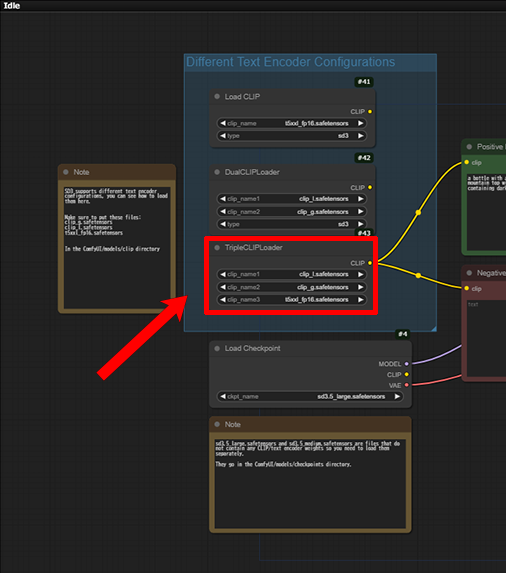

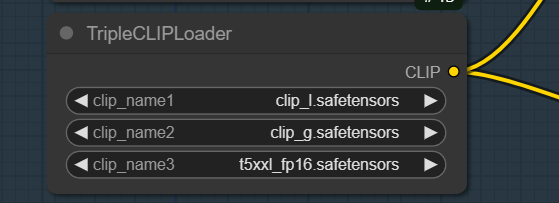

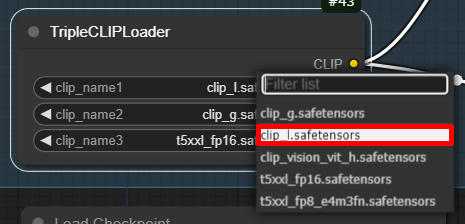

次に各種モジュールを読み込むノード「TripleCLIPLoader」を拡大表示。

clip_g.safetensors、clip_l.safetensors、t5xxlfp 16.safetensorsと3つのCLIPファイルが表示されている。

こちらも念の為クリックして選択し直しておこう。

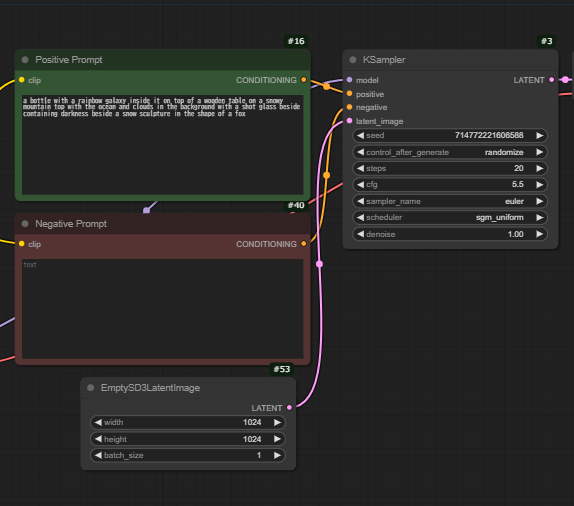

プロンプトやKSamplerモジュールはとりあえずそのままで構わない。

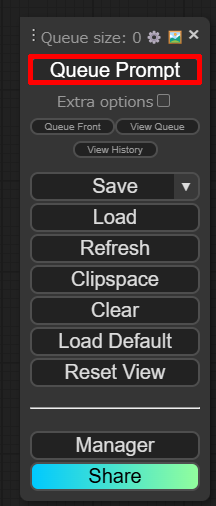

「Queue Prompt」を押せば生成が始まるはずだ。

初回はモデルをロードする時間がかかるためしばらく待つことになる。ロードが終わると画像が生成されていくはずだ。

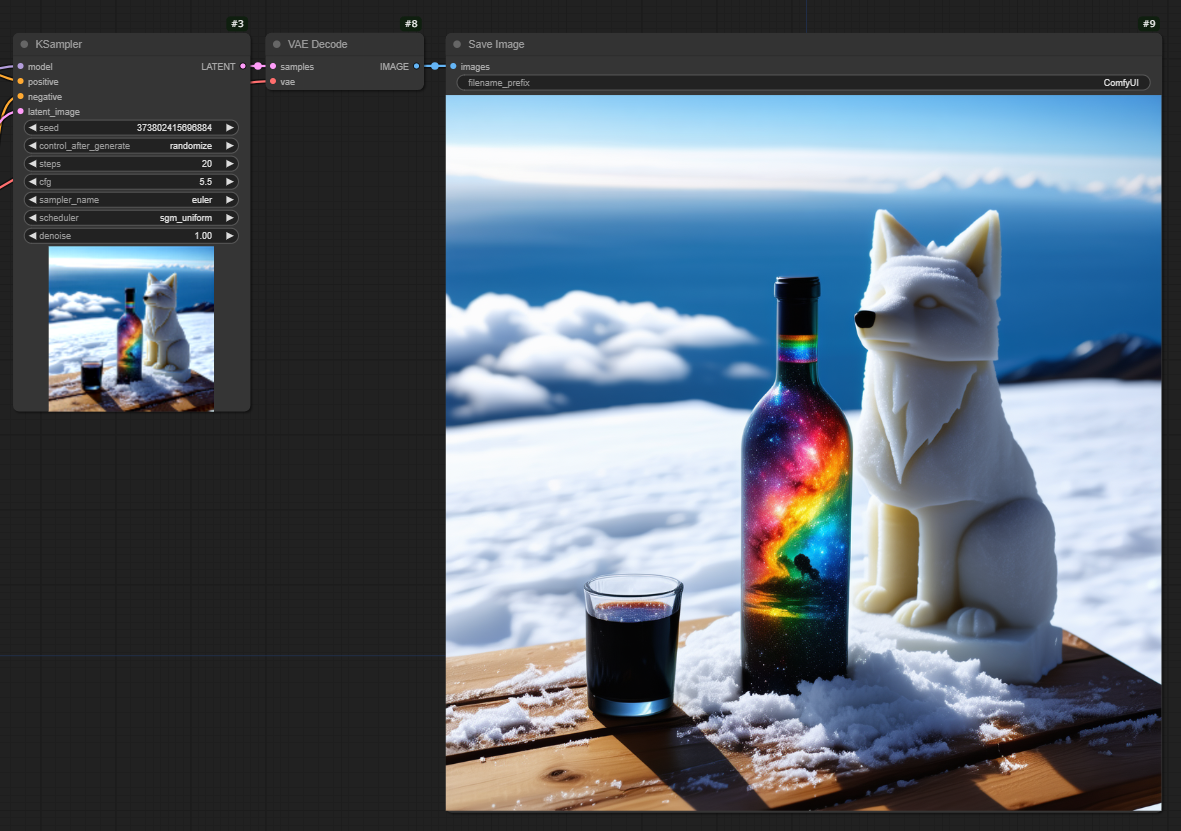

生成された画像はいちばん右端の「Save Image」ノードに表示される。

画像は「\ComfyUI\output」に、Stability Matrixを利用している場合は「\StabilityMatrix\Images\Text2Img」にも保存されている。

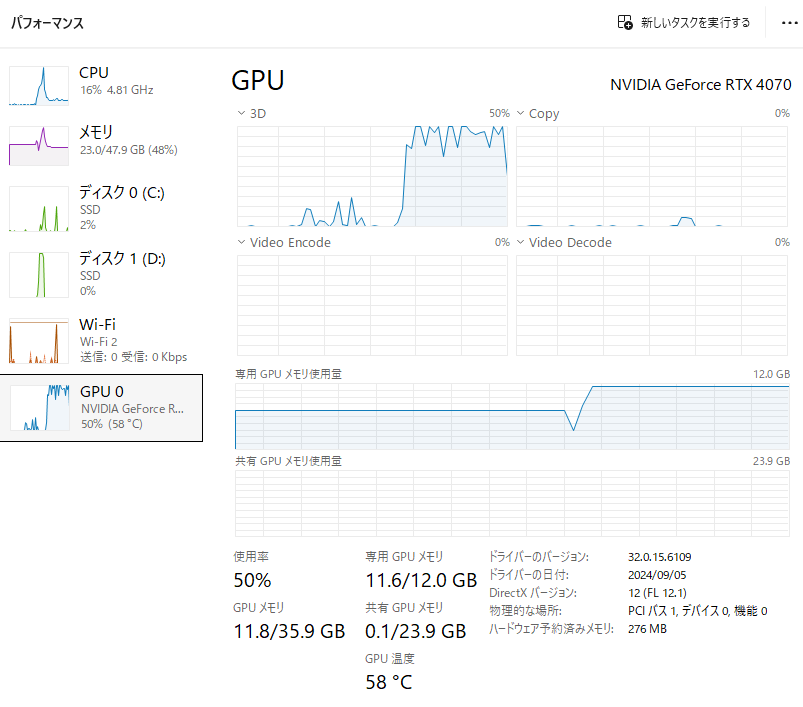

生成時間は初回が66秒、2回目以降は少し早くなり40秒ほどだ。筆者の環境では「WebUI Forge」で「FLUX.1 dev」を使って生成した場合とほぼ同じくらいだ。

GPUの使用率はかなり高く、メモリーは12GBをほぼフルで使ってしまっているようだが、メモリー不足によるエラーは一切出なかった。

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります