OpenAIは11月6日、開発者向けイベント「OpenAI DevDay 2023」を開催した。

開発者向けというだけあり、発表内容は「GPT-4 Turbo」をはじめとする新モデルやAPIについてが多かったが、ChatGPTに関するものもいくつか発表された。

中でも注目はオリジナルのチャットボットを作れる「GPTs」および、作ったものを販売できる「GPT Store」ではないだろうか。

「GPT-4 All Tools」とは?

まずは「GPT-4 All Tools」について説明しておこう。

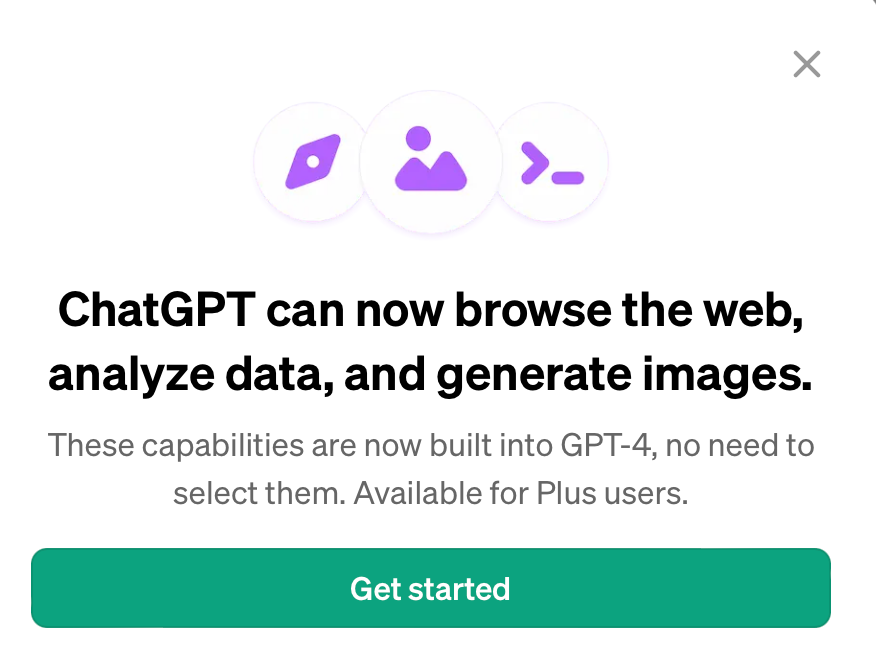

「DevDay」が終了した翌日、いつものように「ChatGPT Plus」にアクセスするとこのようなウィンドウが表示された。

「ChatGPTはウェブブラウズ、データ分析、画像生成ができるようになりました。これらの機能はGPT-4に組み込まれており選択する必要はありません。Plusユーザーはご利用いただけます」

という内容だ。え?どういうこと?Bingによるウェブブラウズも、データ分析(Advanced Data Analysis)も、画像生成(DALL-E 3)も実装されてるけど……。と戸惑いながらも「Get started」をクリックすると……。

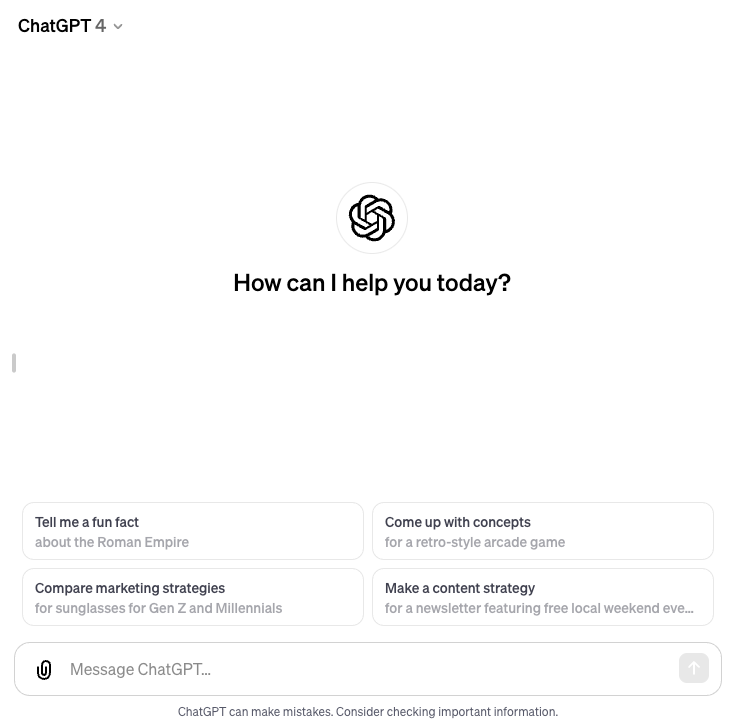

なるほどわかった。モデルセレクターがなくなってるのだな。

モデルセレクターとは、GPT-3.5とGPT-4、そしてGPT-4の中でも「Default」「Browse with Bing」「Advanced Data Analysis」「Plugins」「DALL-E3」と、使いたい機能を選ぶ画面上部にあったウィンドウだ。

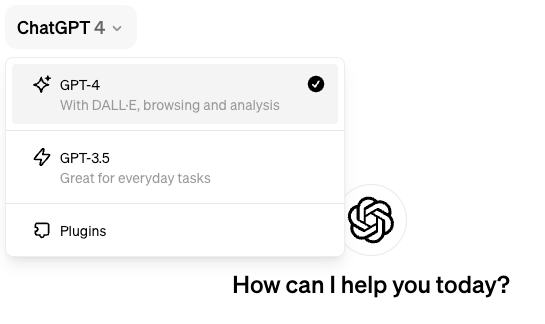

代わりに左上のChatGPT4をクリックすることモデルを切り替えられるようになっている。

GPT-4の説明文には「With DALL-E, browsing and analysis」と書かれているように、これまでモデルセレクターで選ぶ必要があった追加機能が含まれている。つまり最初にGPT-4を選んでおけば、わざわざ切り替えなくてもDALL-E3やBingによるウェブブラウズなどが可能になったのだ。これが「GPT-4 All Tools」だ。

ただし「Plugins」だけはここで選ぶ必要があるようだ。

All Toolsでなにができるか?

では、GPT-4 All Toolsでなにができるかを改めて見ていこう。

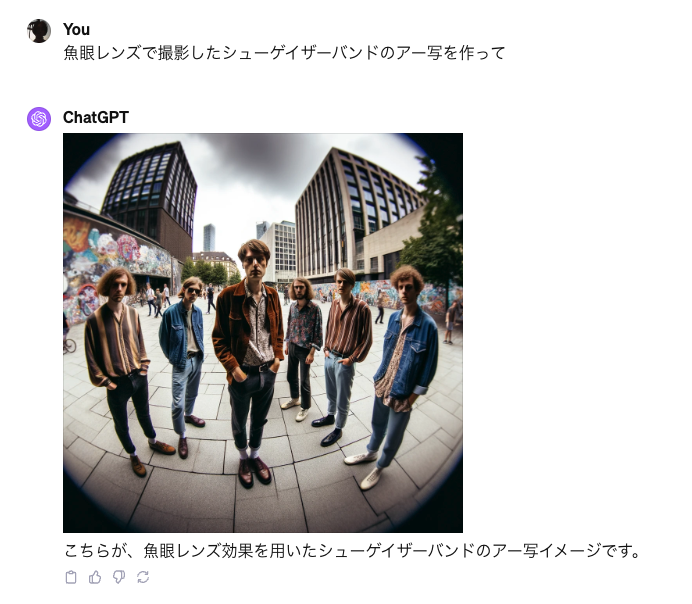

まずは基本のテキスト生成だが、「GPT-4V」によりテキストだけではなく画像を使ったプロンプトも受け付けるようになっている。この例では写真を見せることによって、この写真が魚眼レンズで撮影されていることが説明されている。

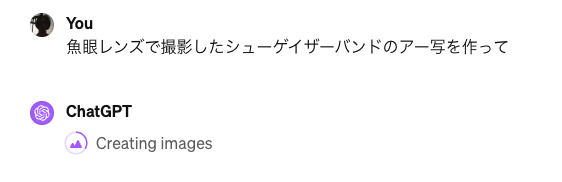

次は画像生成だ。

上記のプロンプトを入力すると、「Creating Images」のアイコンが表示された。DALL-E3が起動しているようだ。

しばらく(30秒〜1分)待つと画像が表示された。さすがDALL-E3、高画質かつプロンプトに忠実だ。

次はプログラムコードを実行させてみよう。

上記のプロンプトを入力すると、Pythonの実行環境が開き、先程作成した画像(pngファイル)を「Pillow」ライブラリの「IMAGE」モジュールを使ってJPEGに変換するプログラムコードが生成される。

さらに自動的にそのコードが実行されJpegファイルを出力、ファイルのダウンロードリンクが表示された。

コードを書くだけではなく実行環境まで準備してくれるこの機能は、これまで「Advanced Data Analysis(旧Code Interpreter)」を選択しなければ利用できなかったものだ。

最後にBingを使ったウェブブラウジングだ。上記プロンプトを入力すると「Searching “recent trends in shoegaze music”」と表示され検索が始まる。

無事検索結果を元にした回答が生成された。内容も極めて妥当だ。

以上、GPT-4 All Toolsでできることを見てきた。すべてがこれまでも実現可能だった内容ではあるが、いちいちモデルを変更する必要がなくなったのは本当にすばらしい進歩だと思う。

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります