Bing AIがマルチモーダルに対応し、画像のアップロードに対応した。画像に何が写っているのか認識し、プロンプトに答えてくれるのだ。まずは、犬の写真をアップロードして、何が写っているのか聞いてみよう。

「黒柴犬の顔のクローズアップ」で「目を開いている」「背景がぼやけている」としっかりと描写してくれた。鼻は黒く、耳がとがっており、敷物の色まで判別している。人間が説明するよりも完ぺきな描写と言っていいだろう。

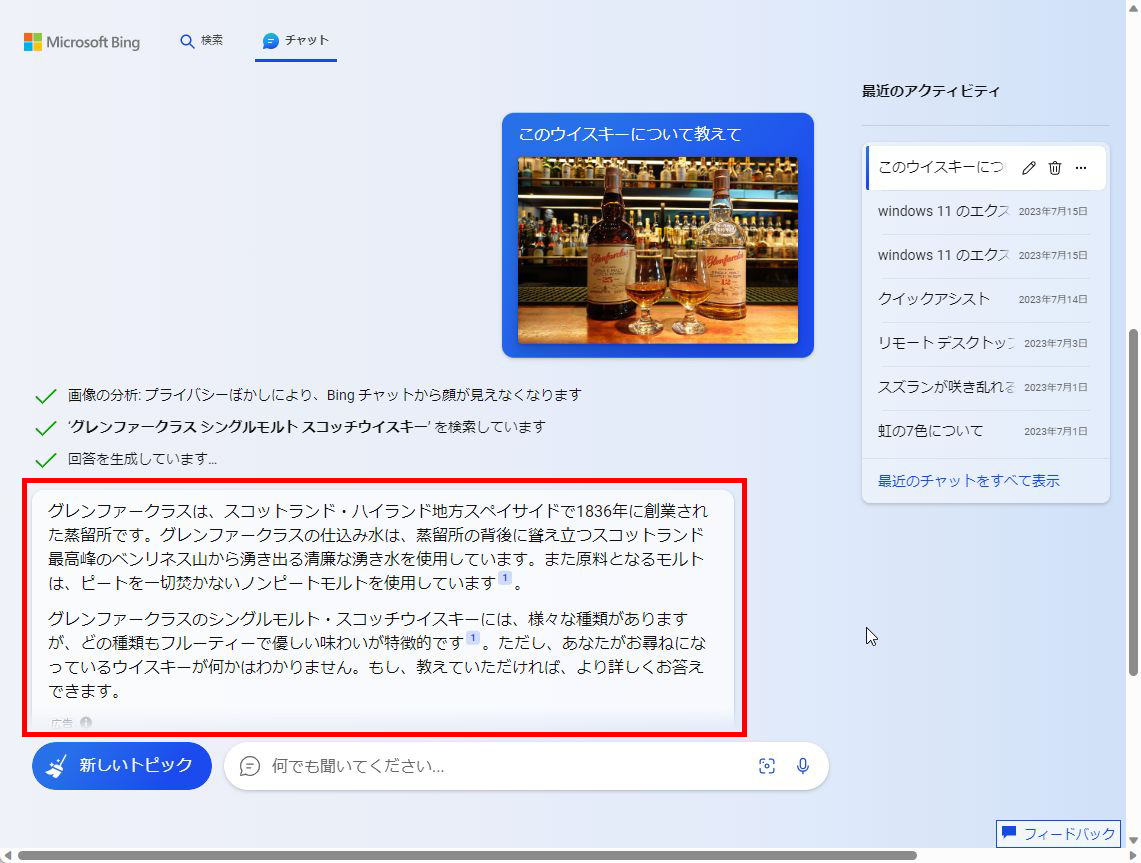

次に、ウイスキーの写真をアップロードして聞いたところ、ぴたりと銘柄を判別し解説してくれた。ラベルを認識しているのだが、文字は小さいし、ロゴになっているのに驚きだ。

解説の最後には、「広告」として、お酒のネットショップへのリンクが表示されている。確かに、Bing AIとのチャット内容に関連する広告ならコンバージョンが高くなることだろう。ユーザーとしては煩わしいが、無料で使えるのだから仕方がない。

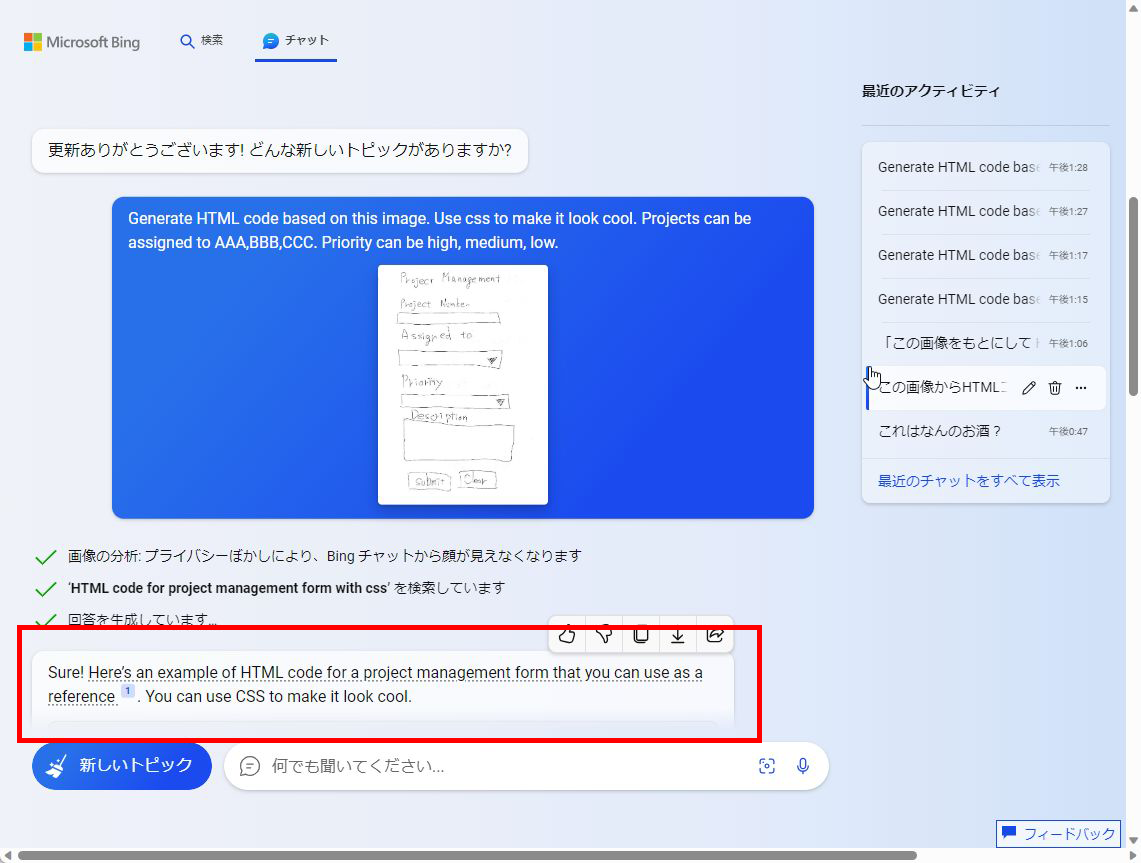

YouTubeのBing公式チャンネルでビジュアルサーチについての動画(Visual Search in Bing Chat - Desktop experience)公開されていた。この中で、手書きしたウェブページのラフを撮影し、Bing AIにアップロードして、HTMLとCSSでコーディングするデモが表示されていた。

早速真似していろいろとやってみたのだが、日本語では途中で止まったり、コーディングはできませんと言われたり、うまくいかなかった。そのため、動画の内容を真似て、同じプロンプトで試してみた。

プロジェクトマネジメントの登録フォームで、アサインする人と重要度、説明などを入力するものだ。プロンプトは映像通り「Generate HTML code based on this image. Use css to make it look cool. Projects can be assigned to AAA,BBB,CCC. Priority can be high, medium, low.」とした。

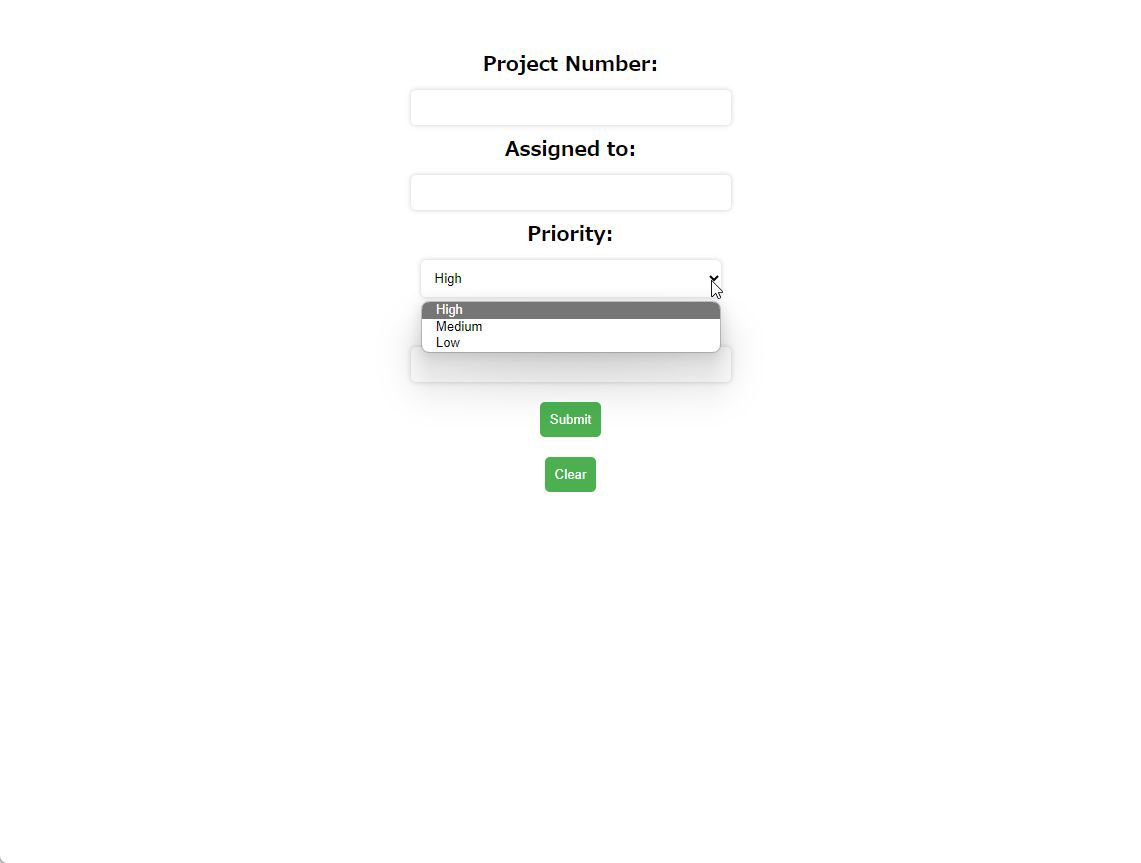

最終的にコードは出力できたが、随分デモとは異なる結果となった。「Project Management」のタイトルは表示されず、アサインするところのメニューは動作せず、デザインもクールではない。

とはいえ「Priority」のプルダウンメニューは動作しており、指定した選択肢が入っていた。「Submit」と「Clear」のボタンもある。プログラミングできない筆者ではここからどう改善すればいいのかわからないが、プログラマーであれば時短ツールとして活用できそうだ。

さまざまな画像をアップロードして試してみたが、まだまだ万能ではない。刺身と言うことはわかっても何の刺身かは判別できないし、風景から場所を特定したりすることはできない。しかし、マルチモーダルの未来を体感することはできる。スマホアプリからも利用できるので、外出先で写真を撮り、質問することも可能だ。まずは、気軽に手近な写真をアップし、「何が写っている?」と聞いてみよう。

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります