OpenAIの呪文から3Dモデルを高速生成するAI、巨大な需要を見込めるが課題は山積み

2022年12月22日 09時00分更新

画像生成AI「DALL-E 2」、テキスト生成AI「GPT-3」、対話AI「ChatGPT」を開発するOpenAIは、テキストから3Dオブジェクトを生成するAI「Point-E」をオープンソース化し、コードをGitHubで公開した。

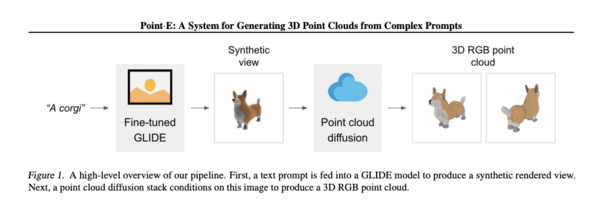

テキストから3段階で3Dモデルを生成

テキストから3Dオブジェクトを生成するAIには、Google ResearchとUC Berkeleyの研究チームが開発した「DreamFusion」があるが、同システムでは生成するのに数時間という時間と多くのビデオカード(GPU)が必要だったが、論文によるとPoint-Eはビデオカード1枚(NVIDIA V100)でも1〜2分という驚くべきスピードで3Dオブジェクトを作成できるという。

実際の生成は2段階で行われる。まずプロンプトを入力すると「テキスト to イメージ」モデルを使用して2D画像が生成される。これはStable DiffusionやDALL·E 2などのAIと同様に、ラベル付き画像でトレーニングされたものだ。

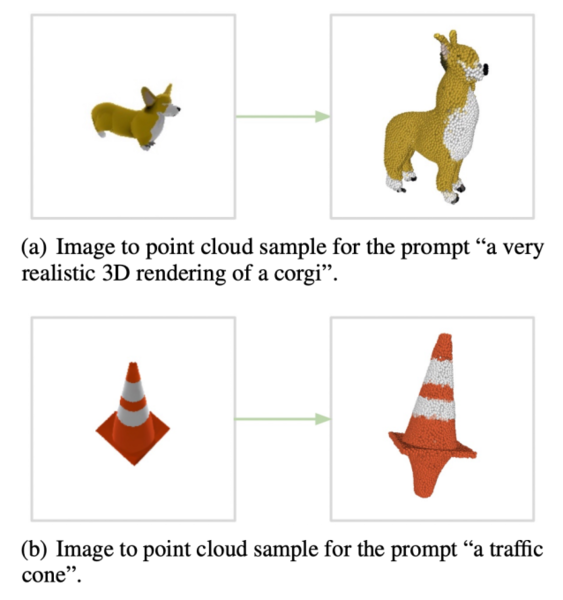

次に「イメージ to 3D」モデルが、生成された2D画像を元に3Dに変換する。

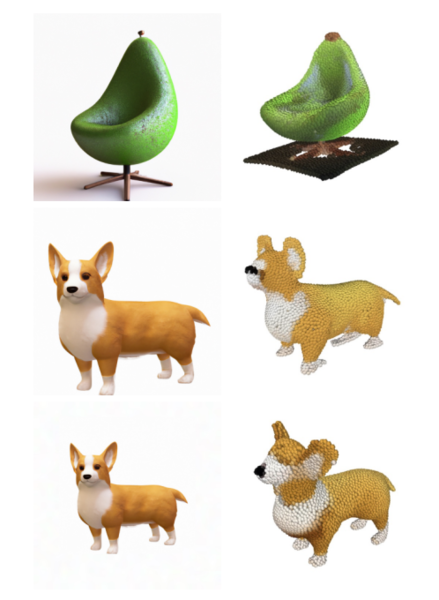

このモデルは頂点と辺と面で構成された従来の3Dオブジェクト(メッシュと呼ばれる)ではなく、点群(point clouds)と呼ばれる点描のような手法で立体を表現している。

点群データはコンピューターと相性がいいため前述の通り非常に高速に動作する(Point-Eの「E」は「Efficiency(効率)」の略で、従来の手法よりも効率的に作成できるのが理由)。

一方、点群データでは物体の細かい形状や質感を捉えることが苦手なため、点群からメッシュへの変換を行うAI、「点群 to メッシュ」モデルが追加で導入された。

とは言え現状このモデルでは、物体の特定の部分を見逃すことがあり、その結果うまく行かないことも多いという。

様々な活用シーンが期待されるが課題も多い

OpenAIの研究者は「我々の手法は、最先端の技術よりは多少パフォーマンスは悪いが、驚くほど短時間で成果物を出すことができる」と論文に記している。

ではこの技術、将来的にはどのような用途で使われるのだろうか。論文では「3Dプリンターを使って実世界の物体を簡単に製造できるかもしれない。また、メッシュ変換モデルがもう少し洗練されれば、ゲームやアニメーションの開発ワークフローに利用することも可能かもしれない」とアイデアが記されている。

3Dデータは映画やテレビはもちろん、建築からインテリアデザイン、機械設計まで様々な分野で利用されており、巨大な需要が見込める一方、データがあれば銃器など危険物を3Dプリンターで生成できてしまうという問題や、すでに3Dモデルの作成を生業にしている業界を破壊するのではないかという懸念、さらにAIの学習データとなる3Dデータの著作権をどう処理するかなど問題は山積みである。

週刊アスキーの最新情報を購読しよう

本記事はアフィリエイトプログラムによる収益を得ている場合があります